Рынок перегрет инфошумом и громкими обещаниями маркетинговых агентств: "Замените весь отдел продаж одним промптом за 15 минут!". В результате неопытные руководители пробуют прикрутить "какую-то нейросеть" (обычно собранную на коленке студентом-фрилансером за 10 000 рублей с использованием устаревших моделей без базы знаний) к сложным бизнес-процессам. Естественно, они терпят болезненное финансовое и репутационное фиаско и заявляют: "ИИ — это хайп, изобретение игрушечное, для крупных серьезных компаний не подходит".

Но дело совершенно не в самой технологии ИИ, а в слабой инженерной культуре интеграторов. Нейросеть (LLM) — это всего лишь мощный двигатель. Чтобы гоночный болид поехал на скорости 300 км/ч без смертельной аварии, этому двигателю нужна телеметрия, рулевое управление, ABS, датчики LiDAR и безупречная дорога. "Голая" модель — это двигатель, брошенный на асфальт.

Сегодня мы разберем 5 самых сокрушительных архитектурных и управленческих ошибок внедрения B2B нейро-систем по состоянию на 2026 год.

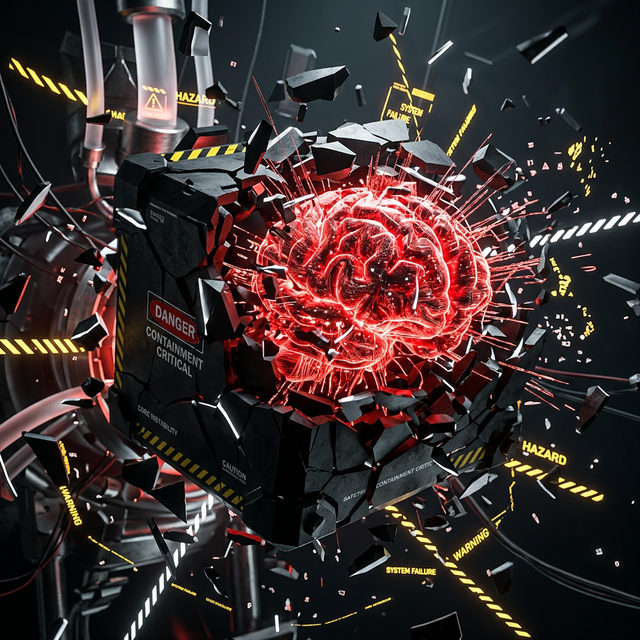

Ошибка 1: "Голая" нейромодель без ограничителей (Zero-Guardrails)

Вы или ваш горе-разработчик просто берете API-ключ, даете модели примитивный системный промпт в стиле: "Ты лучший в мире продавец в компании ООО 'Ромашка', продавай наши услуги за 1 миллион" и пускаете LLM в бой к реальным клиентам.

К чему это приводит в 100% случаев:

"Это классическая фундаментальная проблема LLM (даже мощнейших Llama 4 или GPT-5.4) — галлюцинации и уязвимость к Jailbreak-промптам. Генеративная модель математически стремится "угодить" пользователю и даст логично звучащий, но абсолютно катастрофический для бизнеса ответ.

Как правильно делают инженеры ИНТЕЛЛЕКТ СИСТЕМА: Мы строим сложную архитектуру RAG (Retrieval-Augmented Generation) 2.0 с Графами Знаний. ИИ жестко и бескомпромиссно ограничен векторной базой знаний (вашими юридическими PDF, строгими регламентами РОПа, актуальными прайс-листами из 1С). Если ответа на вопрос клиента нет в базе — нейромодель технически не может его выдумать, у нее включена механика "заземления" (Grounding). Бот перехватывает сценарий и отвечает: "Данный вопрос имеет нестандартные вводные и требует согласования с тех. отделом. Я уже передаю ваш тикет профильному Senior-инженеру, он ответит в течение 10 минут".

Ошибка 2: Автономный бот без интеграции в ядро компании (CRM/ERP)

Бот работает "где-то там", скажем, в отдельном аккаунте Telegram или WhatsApp, но он абсолютно изолирован от кровеносной системы вашего бизнеса — от CRM (amoCRM / Bitrix24 / Salesforce) и ERP систем (1С).

В итоге, чтобы понять, о чем бот 2 часа общался с VIP-клиентом, вашему руководителю отдела продаж нужно идти во внешний мессенджер, бесконечно скроллить переписку и копировать ее руками в CRM. Это не автоматизация, это создание новой проблемы.

Как правильно: Архитектура API First & Agentic Actions. Нейро-сотрудник должен иметь права "цифрового человека". Он обязан самостоятельно двигать карточки по этапам Канбан-доски в CRM. Он вызывает функции (Tool Use), чтобы парсить диалог, самостоятельно заполнять системные поля (Бюджет — 5 млн, ЛПР — Иван Иванович, Главная Боль — срывают сроки, Дата принятия решения — завтра) и ставить Action-задачи живому менеджеру с идеальным кратким "саммари" диалога.

Ошибка 3: Отсутствие триггеров и направленной бизнес-цели (Goal-Oriented Flow)

Если не настроить жесткую бизнес-логику (State Machine), продвинутый ИИ (особенно с высокой температурой генерации) может бесконечно долго, вежливо и философски болтать с клиентом о смысле жизни, погоде на Бали и особенностях сплавов металла. Клиенту будет интересно, но это не генерирует выручку вашей компании.

Как правильно: Внедрение гибридного сценарного фреймворка (Hybrid LLM Routing). ИИ-Агент должен не просто вести диалог, а стремиться выполнить конкретную заложенную Цель (Conversion Goal) — например, шаг за шагом квалифицировать лида по 4 вопросам, взять email и выслать PDF-презентацию. Как только цель выполнена — агент вежливо закрывает первый акт и передает "эстафетную палочку" живой команде (клоузеру). Алгоритмы должны управлять нейросетями, а не отдаваться на их волю.

Ошибка 4: Игнорирование On-Premise и Защиты Конфиденциальных Данных (Data Privacy)

Сливать коммерческую тайну, паспорта клиентов, номера их расчетных счетов и базы поставщиков в публичные API облачных моделей (особенно с отключенным privacy-режимом американских корпораций) — это должностное преступление для Enterprise-сектора и нарушение закона о персональных данных. Вы буквально обучаете чужую модель на своих корпоративных секретах.

Как правильно: Использовать защищенные Enterprise SLA от доверенных провайдеров (где логи API гарантированно не сохраняются для обучения), либо внедрять локальные (On-Premise) открытые модели класса Qwen 3.5/5 или Llama-3 70B на собственных серверах внутри контура компании. Кроме того, обязательно наличие модулей PII Anonymization (Data Masking) перед отправкой любого промпта в нейросеть. Все фамилии, суммы контрактов и ИНН аппаратно заменяются на бессмысленные хэш-токены (User_A, Company_B) до того, как покинут периметр защиты.

Ошибка 5: Синдром "Заплатили, внедрили и забыли"

ИИ — это не микроволновка и не телевизор. Это виртуальный сотрудник. Вы же не сажаете стажера в первый день в отдел, не обнимаете его со словами: "Ну все, продавай, а я поехал в оплачиваемый отпуск на ГОД"?

Как правильно: Принцип постоянного "Human-In-The-Loop" (Человек в цикле обучения). Раз в неделю куратор (обычно РОП или ИИ-интегратор) должен отсматривать сложные диалоги. Современные дашборды, которые мы строим, автоматически помечают красными флагами диалоги, где ИИ запнулся или дал неуверенный ответ (Low Confidence Score). В случае таких ошибок инженер в 2 клика вносит коррективы в RAG-базу.

Любой ИИ-агент первого дня работы — это перспективный Junior. Через месяц интенсивного обучения на ваших паттернах — он крепкий Middle. А через четыре месяца — недосягаемый Senior, который знает тысячестраничный каталог вашей продукции наизусть лучше, чем сам основатель завода.